Колко струва поддръжката на ChatGPT

Цената само за един ден е повече от 1 милион лева

Огромната популярност на ChatGPT прави функционирането му изключително скъпо, съобщава The Information. OpenAI плаща до $700 000 на ден, за да поддържа мощната си инфраструктура в движение. Това сочат данни от изследователската фирма SemiAnalysis.

"По-голямата част от тези разходи се основават на скъпите сървъри, от които се нуждаят", каза Дилън Пател, главен анализатор във фирмата, пред изданието.

Разходите може да са още по-високи сега, каза Пател в последващо интервю пред Insider, тъй като тези оценки се основават на GPT-3, предишния модел, който захранва по-старата и вече безплатна версия на ChatGPT.

Най-новият модел на OpenAI, GPT-4, ще струва дори повече, за да работи, твърди Пател.

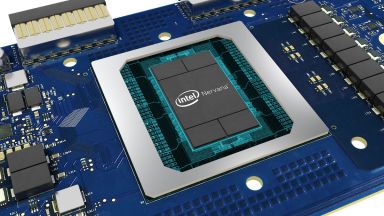

Това не е проблем, уникален за ChatGPT, тъй като AI, особено разговорните, които се удвояват като търсачка, са невероятно скъпи за работа, защото скъпите и специализирани чипове зад тях са невероятно гладни за енергия.

Точно затова Microsoft - която е инвестирала милиарди долари в OpenAI - подготвя свой собствен патентован AI чип. С кодово име Athena, той се разработва от 2019 г.

При внедряването на чипа Microsoft се надява да замени настоящите графични процесори на Nvidia, които използва, в полза на нещо по-ефективно и следователно по-евтино за работа.

А потенциалните спестявания могат да бъдат огромни.

"Athena, ако е конкурентна, може да намали цената на чип с една трета в сравнение с предложенията на Nvidia", каза Пател пред The Information.

Въпреки че това ще отбележи забележително първо нахлуване в AI хардуера за Microsoft - той изостава от конкурентите Google и Amazon.

Миналата седмица главният изпълнителен директор на OpenAI Сам Алтман отбеляза, че "сме в края на ерата" на "гигантските AI модели".

С отчетен размер от над един трилион параметри, най-новият GPT-4 модел на OpenAI може вече да се доближава до границата на практическа мащабируемост, въз основа на собствения анализ на OpenAI.