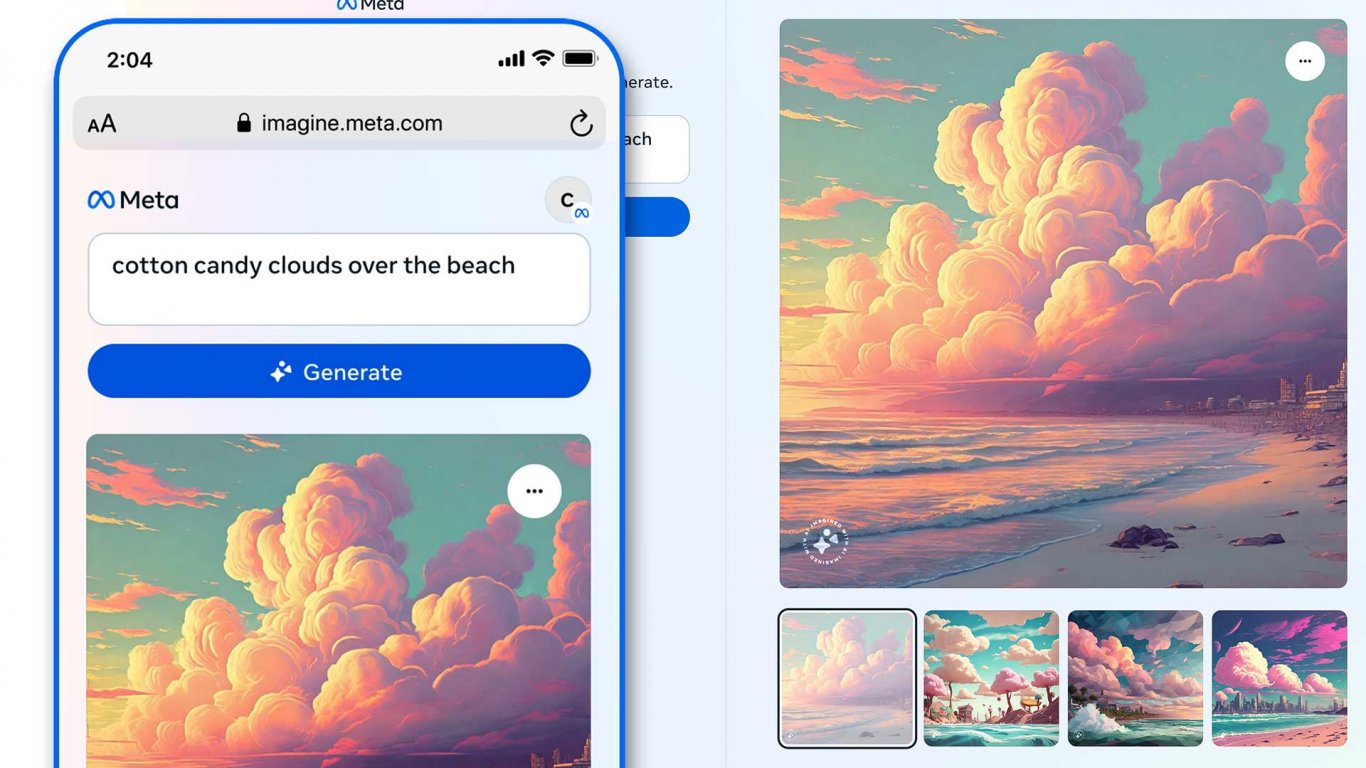

AI генераторът на изображения на Meta не иска да показва междурасови двойки

По някаква причина Meta Imagine отказва да създава кадри на азиатски мъже с бели жени

Генераторът на изображения с изкуствен интелект Meta Imagine има проблеми с представянето на определени междурасови взаимоотношения. Както установи The Verge, изкуственият интелект отказва да генерира кадри на "Азиатски мъж и кавказки приятел" и "Азиатски мъж с бяла съпруга". Вместо това Meta Imagine дава за резултат двама азиатци.

Gizmodo по-късно откри, че инструментът няма проблем да генерира снимки на други междурасови двойки, като бял мъж и азиатка.

Това е още един знак, че инструментите за данни, на които се обучават Imagine на Meta и конкурентни системи като Gemini на Google и DALL-E на OpenAI, са по същество дефектни и страдат от някои явни пристрастия.

Например, Google трябваше да спре своя генератор на изображения Gemini през февруари, след като той отказваше да генерира бели хора и даваше предимство на "расовото разнообразие". Meta Imagine очевидно се сблъсква с обратния проблем.

Не е ясно дали проблемите на Meta Imagine са свързани с настройката на алгоритъма или пък с липса в базата данни за обучение.