Бившият шеф на Google: AI може да застраши човечеството в рамките на пет години

Ерик Шмид предлага създаването на мощна международна НПО група, която да напътства политиците относно изкуствения интелект

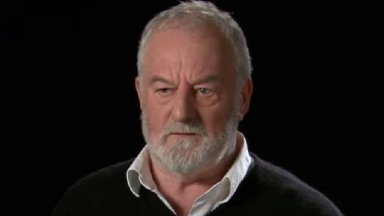

Бившият главен изпълнителен директор на Google Ерик Шмид направи мрачна прогноза за изкуствения интелект. По думите му няма достатъчно бариери, които да спрат технологията от нанасянето на катастрофални вреди.

Говорейки на среща на върха, организирана от Axios тази седмица, Шмид, който сега е председател на Комисията за национална сигурност по изкуствен интелект на САЩ, оприличи AI на атомните бомби, хвърлени от Съединените щати върху Япония през 1945 г.

"След Нагасаки и Хирошима бяха нужни 18 години, за да се стигне до договор за забрани на наземни тестове. Днес нямаме толкова време", каза той на съоснователя на Axios Майк Алън.

Според Шмид сегашните мерки за безопасност "не са достатъчни" - мнение, което той споделя с много изследователи на машинно самообучение.

Само в рамките на пет до десет години, каза бившият шеф на Google, изкуственият интелект може да стане достатъчно мощен, за да навреди на човечеството. Най-лошият сценарий, продължи Шмид, би бил "точката, в която компютърът може да започне да взема свои собствени решения и ако те успеят да получат достъп до оръжейни системи или да достигнат други ужасяващи способности, машините може да ни нанесат огромни поражения".

За да се предотврати този сценарий Шмид твърди, че трябва да се създаде неправителствена организация, подобна на Междуправителствения панел на ООН по изменение на климата (IPCC), който да "подава точна информация на политиците" и да им помага да вземат решения какво да правят когато и ако AI стане твърде мощен.

Не всички са съгласни с тази позиция. Например, водещият екипа за изкуствен интелект на Meta, Ян Лекун, все повече заема противоположната позиция.

Миналия месец той каза пред Financial Times, че технологията далеч не е достатъчно умна, за да застраши човечеството сама.

"Дебатът за екзистенциалния риск е много преждевременен, докато нямаме дизайн за система, която дори може да съперничи на котка по отношение на способностите за учене", каза LeCun за FT, "която нямаме в момента".

Скорошно изследване установи, че мнозинството от разработчиците на AI и професионалистите в IT сферата също смятат изкуствения интелект за силно надценен от медиите.